生成式AI應用遍地開花,但隨意生成的圖片,卻也產生侵權、濫用和倫理等問題。為改善這個痛點,臺大電機工程系團隊開發一款概念抹除技術Receler,就像是一款外掛,可搭配所有開源生成式AI模型使用,能在盡可能保持原有影像的條件下,精準地將不合規的概念抹除,如裸露、暴力、血腥等,又或是特定藝術家、品牌風格或深偽換臉等,開發者不必重新蒐集資料,也不必重新訓練整個模型。這項技術論文,還在2024年底國際頂尖的歐洲電腦視覺國際會議(簡稱ECCV)上發表。

運用對抗網路和交叉注意力機制,精準消除AI生圖的不合規概念

進一步來說,Receler是由臺大電機工程系教授王鈺強及臺大電信工程學研究所博士生黃啟斌、張凱博等人聯手打造。王鈺強解釋,生成式AI可產出文字、影像和語音,就影像生成來說,則透過文字指令輸入、AI模型生成、產出影像。但這種影像生成,可能造成侵權、倫理和濫用問題,比如DeepFake換臉、模仿特定藝術家風格等。於是,如何在不重新蒐集資料、不重新訓練模型的情況下,移除這些不合規的概念、同時保留原本模型的創作能力,成為團隊發想重點。

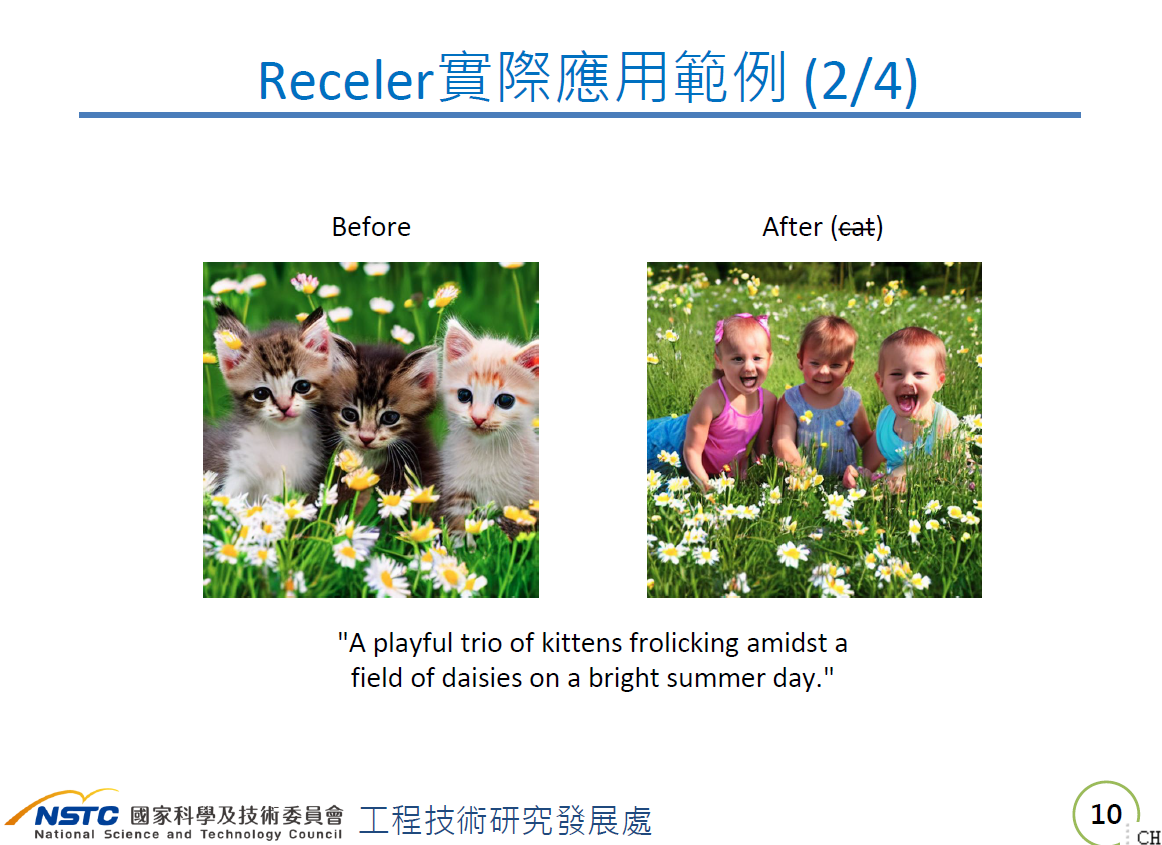

他們鎖定文生圖(text-to-image)類型的開源生成式AI模型(即經預訓練的擴散模型),運用對抗網路(Adversarial Learning),打造出一款輕量級概念橡皮擦Receler,可精準移除AI模型中不合規的概念,並保有模型本身的創作能力。

簡單來說,Receler的運作原理有兩個,首先是概念局部正規化,也就是只移除AI模型中的特定概念、不影響模型其他生成能力,進而保留模型創作能力;另一是優化對抗提示學習,這些提示會誘導模型生成被禁概念的影像,團隊再用這些影像訓練Receler,讓它即使遇到變化多端的提示,也能把被禁概念順利抹除。

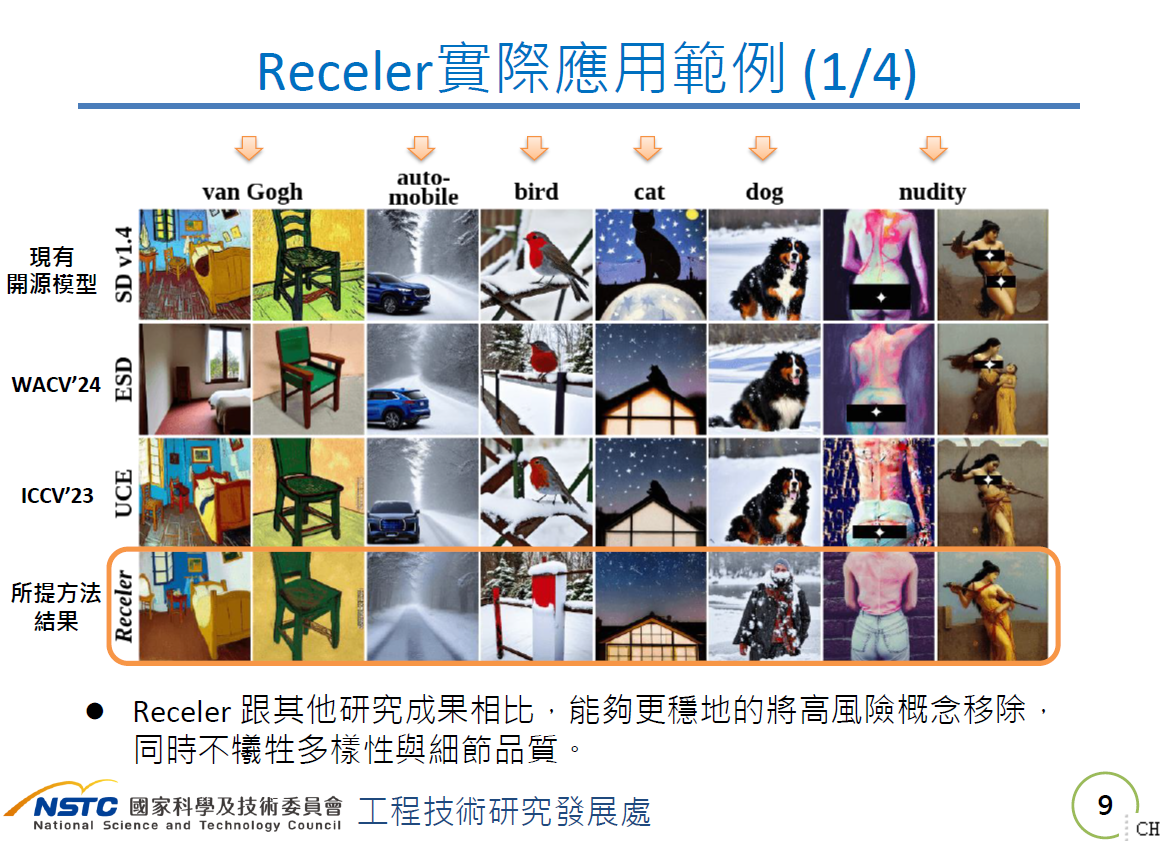

王鈺強展示,與其他概念抹除技術相比,Receler的表現更佳。不論是改變藝術風格、消除特定物件(如汽車、鳥類、貓、狗)還是裸露內容,Receler都能精準實現。(如下圖)

目前,團隊也將Receler開源在GitHub上,供開發者下載使用。不過,Receler雖能抹除不只一項概念,但目前抹除單一概念的能力較佳。