JEDEC官方宣布JESD328标准规范的制定已接近完成,推出全新内存形态SOCAMM2,专为下一代AI和数据中心平台设计。SOCAMM2基于LPDDR5、LPDDR5X,提供矮版、可替换和升级的内存解决方案,具有更高带宽、更低功耗和更好扩展性。其单个针脚最高数据传输率达9.6Gbps(9600MT/s),显著优于现有8533MT/s,满足现代AI训练与推理需求,同时降低能耗和散热要求。该标准还引入SPD功能,用于身份识别与验证,确保可靠性。NVIDIA等厂商正转向基于SOCAMM2的设计。CAMM内存最初由戴尔设计,后贡献给JEDEC成为行业标准,SOCAMM2是更小型化版本,已获微星、华硕等厂商支持。美光将LPDDR5X用于LPCAMM2,首搭联想ThinkPad P1 Gen7笔记本。2025年,美光与NVIDIA将开发AI服务器SOCAMM内存,搭配LPDDR5X内存,单条容量达128GB,三星和SK海力士也加入。

🔧 SOCAMM2是JEDEC制定的新内存标准,基于LPDDR5/LPDDR5X,设计用于下一代AI和数据中心,提供更高带宽(9.6Gbps)、更低功耗和更好扩展性,满足现代AI计算需求。

🔄 CAMM内存最初由戴尔设计,后贡献给JEDEC成为行业标准,SOCAMM2是更小型化的版本,旨在统一行业内存形态,提升兼容性和升级能力。

🚀 主要厂商积极采用SOCAMM2,如NVIDIA转向该设计,微星、华硕等主板厂商和芝奇等内存厂商已发布相关产品,显示行业广泛支持。

🔒 新标准引入SPD功能,用于身份识别与验证,确保内存模块的可靠性,同时美光与NVIDIA计划开发128GB容量的AI服务器SOCAMM内存,进一步推动高性能计算发展。

📅 时间线显示,2022年戴尔首次在Precision 7000系列笔记本中使用CAMM内存,2023年JEDEC完成CAMM2制定,2024年美光将LPDDR5X用于LPCAMM2并首搭联想笔记本,2025年AI服务器SOCAMM内存将问世。

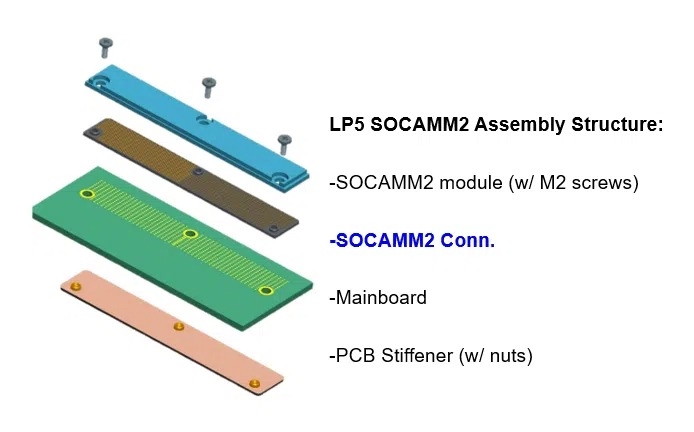

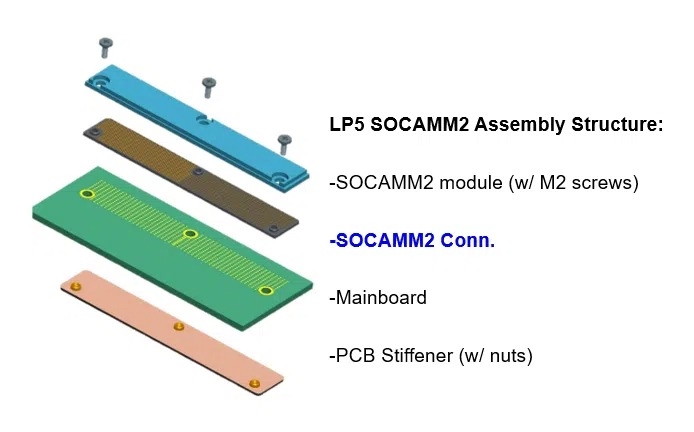

JEDEC官方宣布,JESD328标准规范的制定已经接近完成,一种全新的SOCAMM2(Small Outline Compression Attached Memory Module)内存形态,服务下一代AI和数据中心平台。SOCAMM2标准定义了一种基于LPDDR5、LPDDR5X的矮版、可替换和升级的内存,可提供更高带宽、更低功耗、更好扩展性。

它的单个针脚最高数据传输率可达9.6Gbps,也就是9600MT/s,对比现有的8533MT/s有显著提升,满足现代AI训练与推理对带宽的需求,同时能耗和散热需求更低。

它还引入了SPD功能,可用于身份识别与验证,确保满足可靠性需求。

NVIDIA等厂商正在将他们的服务器平台转向基于SOCAMM2的设计,尽管在物理层面可能有所不同,但也基本相似。

JEDEC确认,JESD328 SOCAMM2规范将在近期发布。

CAMM内存最初是戴尔的专有设计,由戴尔高级工程师Tom Schnell打造,2022年4月发布的戴尔Precision 7000系列笔记本工作站首次搭载了DDR5 CAMM 内存。

2022年底,戴尔将CAMM技术贡献给JEDEC,希望能成为行业统一标准。

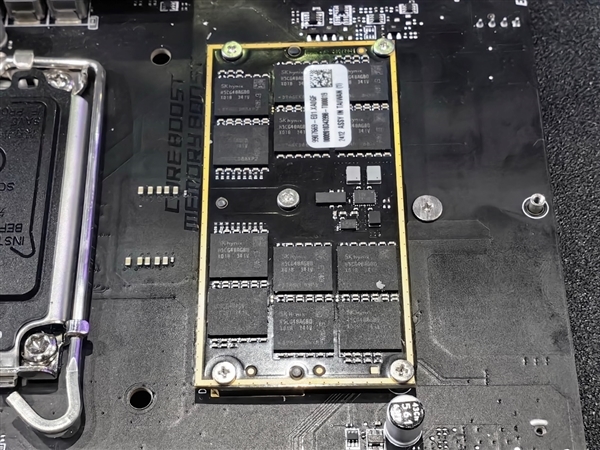

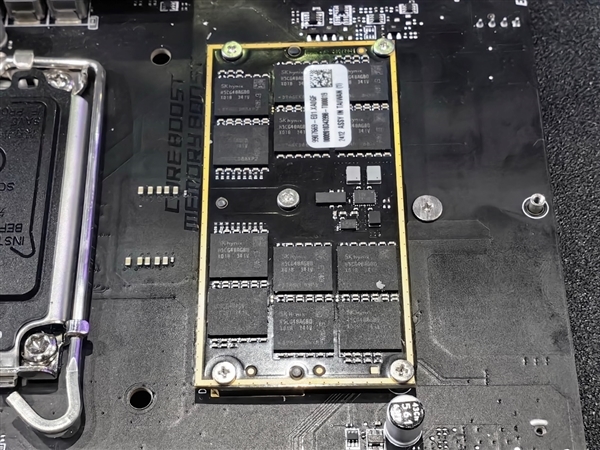

2023年12月,JEDEC完成了更小型化的CAMM2标准的制定,微星、华硕等主板厂商和芝奇等内存厂商随即发布了相关产品。

更早些时候的2023年9月,三星宣布将LPDDR5X内存用于更小型化的LPCAMM产品上。

2024年1月,美光宣布将LPDDR5X内存用于LPCAMM2,并首次搭载于2024年5月的联想ThinkPad P1 Gen7笔记本。

2025年3月,美光与NVIDIA共同宣布,开发面向AI服务器SOCAMM内存,搭配LPDDR5X内存,最大单条容量128GB,三星和SK海力士也随后加入。

查看评论